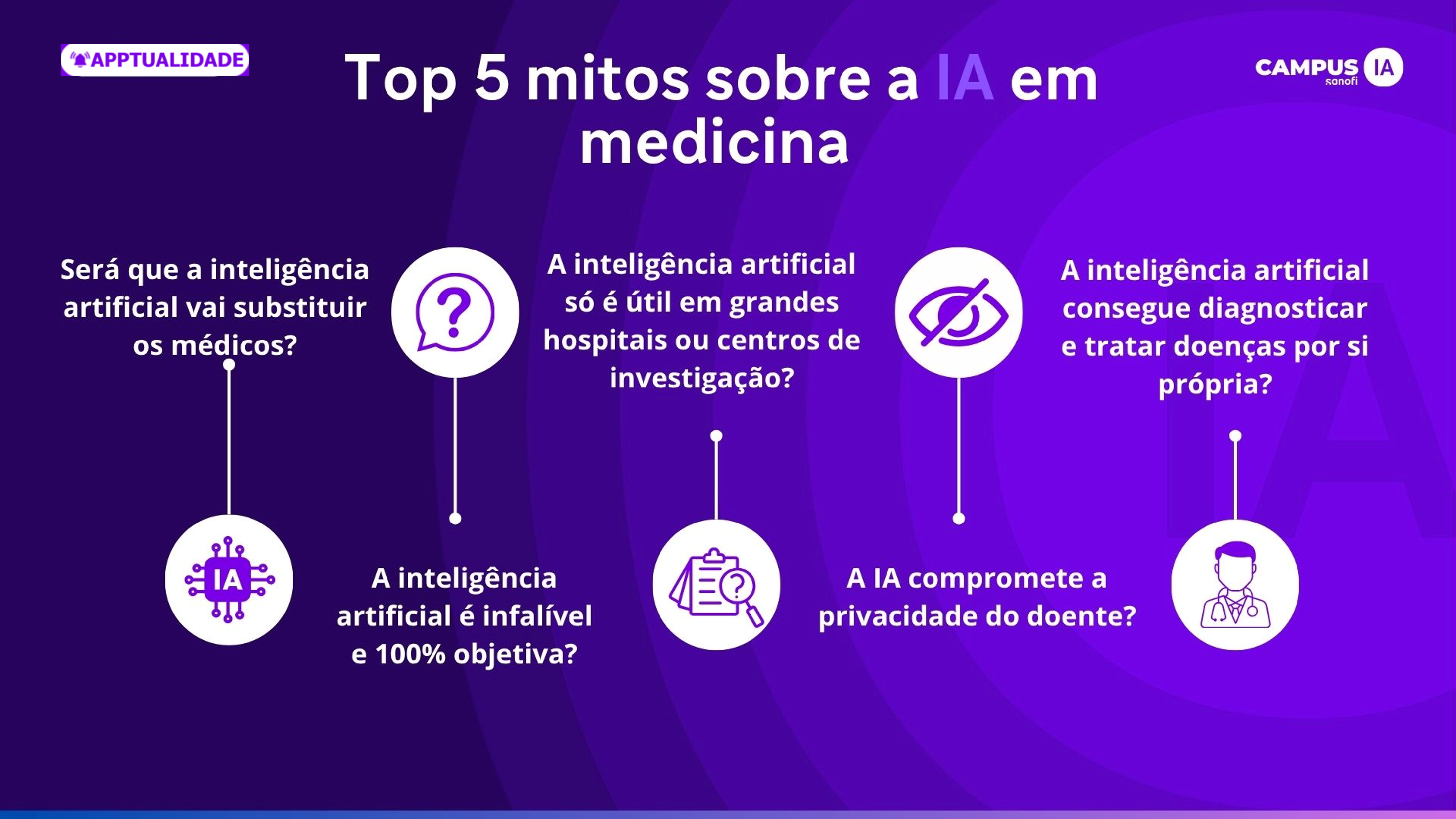

Os 5 principais mitos sobre inteligência artificial na medicina

A inteligência artificial (IA) surgiu com grande impacto na área da saúde, oferecendo soluções inovadoras que vão desde ferramentas de apoio ao diagnóstico até assistentes virtuais que otimizam os processos administrativos. Este avanço abriu as portas para uma nova era na medicina moderna, mas também gerou dúvidas, medos e uma quantidade considerável de desinformação.

Neste artigo, abordamos e esclarecemos os cinco mitos mais comuns sobre o uso da IA na medicina, contrastando cada um com as evidências científicas mais atuais e as recomendações de organismos internacionais como a Organização Mundial da Saúde (OMS), a Comissão Europeia e publicações acadêmicas renomadas.

Este é talvez o mito mais difundido. A realidade é que a IA não substitui o julgamento clínico ou a empatia do profissional de saúde, mas atua como uma ferramenta de apoio para melhorar a eficiência, a precisão do diagnóstico e a gestão clínica.

De acordo com o relatório da OMS sobre ética e inteligência artificial, a supervisão humana é indispensável em todas as fases do uso da IA na saúde1. A IA pode automatizar tarefas específicas, como priorizar estudos radiológicos, mas as decisões clínicas devem ser mantidas sob controle médico.

Estudos como os publicados no The Lancet Digital Health também confirmam que a combinação de profissionais de saúde com IA melhora os resultados diagnósticos, especialmente em áreas como radiologia ou dermatologia2.

A objetividade da IA não é exata. Se os dados de treino forem tendenciosos ou incompletos, os algoritmos podem perpetuar esses erros, afetando a equidade no acesso e na qualidade do atendimento.

Um estudo revelador publicado na Science mostrou que um algoritmo amplamente utilizado nos EUA subestimou o risco clínico de pacientes afro-americanos, pois foi baseado em custos históricos e não em critérios clínicos3.

Além disso, a Nature Medicine identificou falhas clínicas significativas causadas por estratificações erróneas em modelos de aprendizagem de máquina, destacando a importância de validar clinicamente qualquer ferramenta antes da sua adoção4.

Este mito foi superado pela realidade de múltiplas aplicações acessíveis e adaptáveis. Existem ferramentas que permitem que pequenos centros de investigação e consultórios particulares beneficiem da IA para, entre outras funções:

- Gerir compromissos com mais eficiência.

- Reduzir a carga administrativa através de resumos automatizados.

- Apoiar a triagem clínica ou priorizar os pacientes com base nos sintomas.

De acordo com a Comissão Europeia, a IA pode melhorar significativamente os cuidados de saúde primários, especialmente se for projetada com uma abordagem centrada no utilizador5. A chave é adotar soluções interoperáveis, éticas e sustentáveis.

A preocupação com a privacidade é legítima, mas não implica que a IA seja incompatível com o respeito ao sigilo médico. Qualquer sistema de IA implementado no campo clínico deve estar em conformidade com regulamentos como GDPR (na Europa) ou HIPAA (nos EUA).

O relatório da OMS estabelece seis princípios éticos fundamentais, incluindo transparência, proteção da autonomia humana e responsabilidade1. Além disso, existem soluções tecnológicas que permitem a anonimização e a rastreabilidade dos dados clínicos sem comprometer a utilidade da IA.

A OMS recomenda seis princípios éticos fundamentais para o uso da IA na medicina, incluindo:

- Proteção da autonomia humana.

- Transparência.

- Inclusão e equidade.

- Segurança e responsabilidade.

A chave é implementar a IA de forma ética, supervisionada e em estrita conformidade com os padrões legais e técnicos de cada país.

Nenhum sistema de IA está autorizado a diagnosticar ou tratar pacientes de forma autónoma. A sua função é apoiar, não substituir.

A FDA e a EMA concordam que a IA na medicina deve ser categorizada como uma ferramenta médica sob supervisão. O diagnóstico deve permanecer uma decisão humana baseada no contexto clínico, história, exame e julgamento profissional6.

Mesmo as ferramentas mais avançadas, como as que detectam retinopatia diabética ou cancro de pele, requerem revisão e validação médica contínuas para garantir sua confiabilidade e relevância clínica.

Conclusão: Dos mitos às evidências

A IA representa uma oportunidade para fortalecer a prática clínica, melhorar o acesso aos cuidados e personalizar os tratamentos. Mas para que isso aconteça, é necessário desmistificar o seu funcionamento e entender o seu verdadeiro alcance e limitações.

No Campus AI, promovemos uma adoção responsável, informada e ética da inteligência artificial na medicina. O futuro não está em substituir o profissional de saúde, mas em acompanhá-lo, capacitá-lo e proteger sempre a relação médico-paciente.

A inteligência artificial não substitui o profissional de saúde, mas sim melhora a sua capacidade de tomada de decisões, diagnóstico e apoio ao paciente. Compreender os seus limites e possibilidades é essencial para integrar esta tecnologia de forma ética, segura e útil na prática médica

Os recursos e funcionalidades mencionados neste site não foram desenvolvidos, financiados, promovidos ou validados pela Sanofi. A Sanofi recolhe-os e descreve-os no Campus IA apenas para fins ilustrativos e não é responsável pela precisão ou integridade das informações resultantes do seu uso ou das opiniões expressas sobre eles. É responsabilidade do profissional de saúde garantir o uso e monitoramento adequados dos resultados obtidos através da inteligência artificial, bem como verificar a veracidade das informações e a interpretação das opiniões dos especialistas. A inteligência artificial não deve substituir o julgamento humano do profissional de saúde, mas sim complementar o exercício da sua profissão.

MAT-PT-2300016- 4.0 - 03/2026